一文看懂:深度学习激活函数 PDF 下载

相关截图:

主要内容:

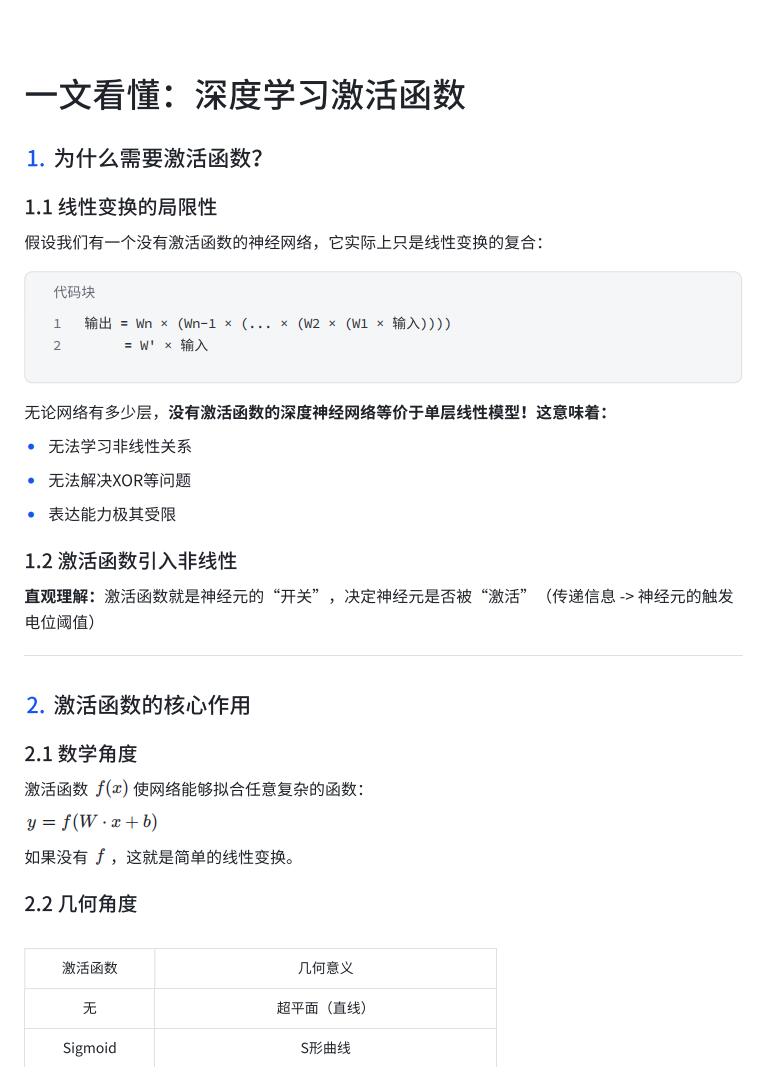

⽆论⽹络有多少层,没有激活函数的深度神经⽹络等价于单层线性模型!这意味着:

•

⽆法学习⾮线性关系

•

⽆法解决XOR等问题

•

表达能⼒极其受限

1.2 激活函数引⼊⾮线性

直观理解:激活函数就是神经元的“开关”,决定神经元是否被“激活”(传递信息 -> 神经元的触发

电位阈值)

2. 激活函数的核⼼作⽤

2.1 数学⻆度

激活函数 f(x) 使⽹络能够拟合任意复杂的函数:

y = f(W ⋅ x + b)

如果没有 f ,这就是简单的线性变换。

2.2 ⼏何⻆度

激活函数

⼏何意义

⽆

超平⾯(直线)

Sigmoid

S形曲线

1

2ReLU

折线

多个ReLU组合

可以逼近任意凸函数

2.3 神经科学⻆度

激活函数模拟了⽣物神经元“全有或全⽆”特性

•

当输⼊超过阈值时,神经元“激活”

•

否则保持“静默”

3. 常⽤激活函数详解

3.1 Sigmoid(S形函数)

数学公式

•

σ(x) = 1 + e−x

1

导数

•

σ (x) =

′

σ(x) ⋅ (1 − σ(x))

优缺点

优点

1. 输出范围(0, 1), 表⽰概率⽅便

2. 光滑,可导

3. 适合⼆分类问题

缺点

1. 梯度消失问题:x很⼤或很⼩时梯度接近于0

2. 输出⾮零去中⼼化(影响收敛速度)

3. 指数运算计算较慢

适⽤场景

•

⼆分类问题的输出层

•

需要概率输出的场景